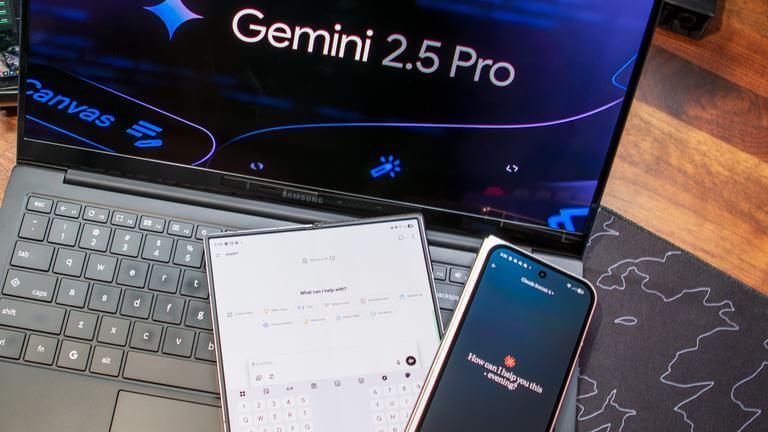

人工智能领域的竞争正进入一个更加注重效率和成本的全新阶段。谷歌于7月22日正式宣布,其Gemini AI家族中运行速度最快、最具成本效益的型号——Gemini 2.5 Flash-Lite,已结束测试阶段,其稳定版本现已全面向全球开发者和企业开放。这一里程碑式的发布,旨在通过极致的速度和极具吸引力的API定价,大幅降低先进AI技术的应用门槛,赋能更广泛的实时应用场景。

速度与成本的极致平衡

Gemini 2.5 Flash-Lite的核心定位非常明确:在保持强大性能的同时,提供闪电般的响应速度和无与伦比的经济性。谷歌官方数据显示,该模型是整个Gemini系列中处理速度最快的。这一特性使其成为处理高并发、低延迟任务的理想选择,例如实时聊天机器人、交互式内容生成、以及需要即时反馈的智能分析系统。在当今追求即时响应的用户体验时代,毫秒级的延迟差异都可能影响产品的成败,Flash-Lite的出现恰好满足了市场的这一迫切需求。

在成本方面,Gemini 2.5 Flash-Lite的定价策略极具颠覆性。其API调用价格设定为每百万输入tokens仅需0.1美元,每百万输出tokens为0.4美元。这一极具竞争力的价格,使得初创公司、独立开发者乃至预算有限的大型企业,都能够以极低的成本构建和部署复杂的AI应用。此前,高昂的API费用一直是许多创新想法商业化落地的主要障碍,而Flash-Lite的推出,无疑为整个AI生态系统注入了新的活力,有望催生出一大批过去因成本问题而无法实现的创新应用。

内置推理能力,轻巧而不简单

尽管Gemini 2.5 Flash-Lite主打“轻量”和“快速”,但这并不意味着它在智能性上做出了巨大妥协。谷歌特别强调,强大的推理能力被直接内置于模型之中。这意味着Flash-Lite不仅仅是一个简单的信息处理或文本生成工具,它能够理解复杂的指令、进行逻辑推断,并根据上下文提供富有洞察力的回答。这一特性使其与市面上其他一些单纯追求速度而牺牲理解能力的轻量级模型划清了界限。开发者可以利用其内置的推理能力,构建出更加智能和人性化的应用,而无需在速度和智能之间做出艰难的权衡。

理想应用场景与战略意义

凭借其独特的优势组合,Gemini 2.5 Flash-Lite非常适合以下几类应用场景:

大规模实时交互:为网站和移动应用提供智能客服机器人、虚拟助手,能够同时处理海量用户的查询并提供即时、连贯的回答。

动态内容摘要与分析:快速从长篇文档、财报、新闻流或用户评论中提取关键信息、生成摘要或进行情感分析。

智能数据标注与分类:在数据预处理阶段,以极高的效率自动完成文本分类、实体识别和数据标注任务,大幅提升机器学习工作流的效率。

代码辅助与生成:为开发者提供实时的代码片段建议、错误排查和简单的代码生成功能,加速软件开发周期。

从战略层面看,Gemini 2.5 Flash-Lite的发布是谷歌AI产品矩阵中的一次关键补强。它与功能更全面、更强大的Gemini 1.5 Pro和即将到来的Ultra模型形成了高低搭配,构成了完整的产品线。这种多层次的策略,使得谷歌能够满足从尖端科研到大规模商业部署的各类市场需求。在与OpenAI的GPT系列、Anthropic的Claude系列等对手的激烈竞争中,Flash-Lite成为了谷歌抢占高频、高并发应用市场的一把利器。它向市场传递了一个清晰的信号:谷歌不仅能打造出性能最顶尖的“旗舰”模型,也能提供最具性价比的“国民级”AI工具,旨在让AI技术真正实现普惠化,渗透到社会经济的每一个角落。