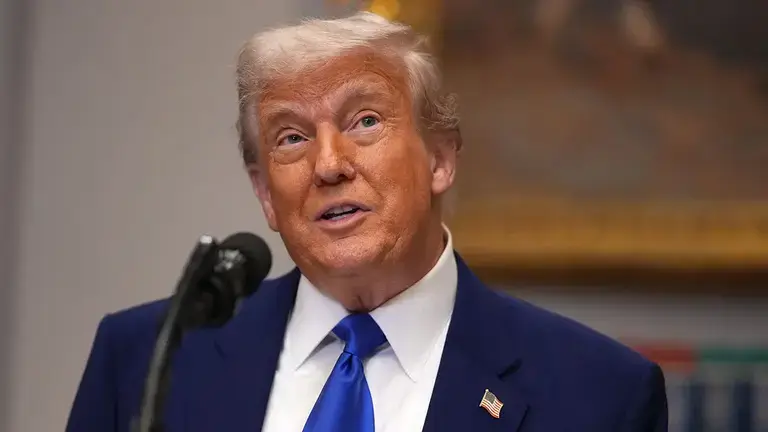

人工智能技术的滥用正将网络诈骗推向一个全新的、令人不寒而栗的高度。近日,一则骇人听闻的案件引发了公众对AI“深伪”(Deepfake)技术威胁的广泛关注:一个家庭痛陈,他们的母亲遭遇了一场精心策划的骗局,骗子利用伪造的著名美剧《综合医院》(General Hospital)男演员史蒂夫·伯顿(Steve Burton)的视频,不仅骗光了她一生的积蓄,甚至诱使其变卖了公寓。这起案件血淋淋地揭示了,当AI换脸技术与传统的“杀猪盘”骗局相结合时,其杀伤力有多么巨大。

情感操纵与技术伪装的致命结合

据受害者家属透露,这场骗局始于社交媒体。骗子首先创建了一个冒充史蒂夫·伯顿的虚假账号,并主动联系了受害者。在初步建立信任后,骗子便开始使用Deepfake技术制作高度逼真的视频,视频中的“史蒂夫·伯顿”与受害者进行看似真实的互动,表达爱意,分享“私人生活”,并构建一个令人信服的虚假情感关系。在受害者深信自己正与心仪的明星进行秘密交往后,骗子便开始以各种借口索要金钱,例如“需要资金解决合同纠纷”、“投资一个秘密项目需要帮助”等等。在情感和技术的双重操纵下,这位女士一步步陷入圈套,最终将自己的所有财产,包括变卖房产所得,悉数转给了骗子。

专家解读:如何识破AI伪造视频的“画皮”

随着Deepfake技术门槛的降低,普通人也可能成为下一个受害者。为了帮助公众提高警惕,网络安全专家们详细分析并总结了识别伪造AI视频的几个关键要点。虽然AI生成的内容越来越逼真,但仔细观察下,仍有迹可循:

观察面部细节与表情连贯性

注意观察视频中人物的眨眼频率。AI模型在模拟眨眼这一生物本能时,常常会出现不自然的模式,例如完全不眨眼,或者眨眼频率过高、过低。此外,面部表情是否与语音语调、情感表达同步也是一个关键。伪造视频中的笑容或愤怒表情可能显得僵硬、不自然,如同“贴”在脸上,缺乏真实肌肉牵动的细微变化。

检查口型同步与音频质量

口型与语音的完美同步是Deepfake技术的一大难点。仔细观察人物说话时的嘴唇动作,看是否与所说的每一个音节都精确匹配。任何延迟、错位或模糊的口型都可能是危险信号。同时,也要留意音频本身,伪造视频的声音可能会有机器感、不自然的停顿或背景噪音与画面环境不符的情况。

留意光影、肤色与边缘瑕疵

光照是另一个容易暴露问题的环节。检查人物脸上的光线和阴影是否与周围环境的光源一致。例如,如果背景显示是户外阳光下,但人物脸上却缺少相应的高光和阴影,就很可疑。此外,AI生成的皮肤纹理有时会过于平滑,缺乏毛孔、皱纹等真实细节。在人物脸部边缘,特别是头发与脸颊、脖子的交界处,可能会出现模糊、扭曲或像素不匹配的瑕疵,这是“换脸”算法留下的痕迹。

终极防线:保持理性和怀疑精神

技术手段的鉴别固然重要,但最根本的防范措施源于人的认知。专家强调,面对网络上的陌生人,尤其是那些身份特殊(如名人、富商)且主动示好并迅速提出金钱要求的人,必须保持高度警惕。这是一个典型的社交工程骗局特征。无论对方发来的视频看起来多么真实,一旦涉及到转账汇款,就应该立即停止并将其视为骗局。公众需要建立一种“健康怀疑”的心态,教育家中的长辈和青少年,让他们了解这类新型骗局的存在。在AI时代,眼见已不一定为实,保持清醒的头脑和基本的安全常识,才是保护自己和家人财产安全的终极防线。